OpenResty Edge × Kubernetes で実現する統合管理プレーン

Kubernetes クラスタでオートスケーリングがトリガーされるたび、運用チームを待ち受けているのは、自動でトラフィックを受け入れられるゲートウェイではなく、承認待ちのノードリストです。新たに起動した数十ものゲートウェイインスタンスが、トラフィックを割り当てるための手動承認を待っているのです。クラウドネイティブアーキテクチャに精通したエンジニアであれば、このような手動介入が運用負荷を増大させるだけでなく、障害からの自動復旧時に制御不能な遅延を生む原因となることをご存知でしょう。これは運用上のミスではなく、従来のゲートウェイ管理モデルに内在する構造的な欠陥です。このモデルは、静的な承認フローをシステム制御の前提としていますが、動的なスケジューリングが基本のコンテナエコシステムにおいて、人為的な介入は可用性のボトルネックになりがちです。結果として、設定ドリフトのリスクは増え続け、エンジニアは繰り返されるノードの登録管理や状態の同期といった作業に忙殺され、Kubernetes がもたらす伸縮性のメリットは、この手動プロセスによって打ち消されてしまうのです。本記事では、ノード管理、マルチクラスタ管理、そしてアップストリームの階層化という3つの観点から、OpenResty Edge が Kubernetes のアーキテクチャと連携し、こうした構造的な摩擦をいかにして解消するかを解説します。

K8s 時代のゲートウェイが抱えるジレンマ:静的環境を前提とした管理モデルと、動的なクラウドネイティブ環境とのミスマッチ

Kubernetes が提供する最大の価値は、その弾力性にあります。しかし、多くの企業がそのメリットを享受する過程で、ある厄介な現実に直面します。それは、トラフィックの入口となるゲートウェイ層の管理モデルが未だに物理サーバー時代のままであり、結果としてゲートウェイがシステム全体の「保護者」から「ボトルネック」へと変質してしまっているという問題です。

課題 1:弾力性を阻む「ラストワンマイル」問題。 K8s 環境では、Pod のスケジューリング、再起動、スケールアウト・インといったイベントは日常的に発生します。もしゲートウェイノードが再起動やスケールアウトを行うたびに、運用チームの手動承認を経なければクラスターに参加できないのであれば、K8s がもたらす弾力性の価値は、その手動プロセスによって大きく損なわれてしまいます。障害の自動復旧時やトラフィックが急増した際に発生する、この「分単位」の対応時間は、サービス可用性における致命的な弱点となり得ます。

課題 2:マルチクラスター管理における設定の不整合拡大。 ビジネスの成長に伴い、企業が開発・テスト・本番といった環境別、あるいは地域別や事業部門別に複数の K8s クラスターを運用することは珍しくありません。しかし、統一された管理プレーンが存在しない場合、各クラスターのゲートウェイ設定、セキュリティポリシー、ルーティング規則に「ドリフト(乖離)」が発生することは避けられません。このような設定の不整合は、潜在的な障害原因となるだけでなく、クラスター間のディザスタリカバリやマルチアクティブ構成といった、より高度なアーキテクチャを実現する上での大きな阻害要因となります。

課題 3:マルチチームでのプラットフォーム共有における、責任範囲の曖昧さ。 プラットフォームチームと複数の事業部門がゲートウェイの設定を共同で管理している場合、権限範囲が明確に分離されていなければ、一見すると局所的に思える変更が、他のチームのアップストリームやルーティングにまで影響を及ぼす可能性があります。問題発生時の調査では、「誰が変更権限を持ち、何を、どのように変更したのか、そして影響範囲はどこまでか」を迅速に特定することが困難になり、結果として調整コストとオペレーションミスのリスクが増大します。

これら 3 つの課題に共通する根本原因は、静的なインフラを前提に設計された管理モデルが、動的なクラウドネイティブ環境において構造的な機能不全に陥っているという点にあります。ゲートウェイは、すべてのトラフィックが集約される経路上に位置するため、その管理モデルの陳腐化はリスクを増幅させ、サービスシステム全体へと波及させてしまうのです。

これらの課題に対し、OpenResty Edge は、柔軟に組み合わせ可能な実践的アプローチを提供します。K8s との間で事前に信頼関係を確立しておくことで、ゲートウェイノードを自動的に管理下に置きます。単一の管理プレーンから複数のクラスター接続を維持し、クラスターを横断したアップストリームの集約もサポートします。さらに、アップストリーム側では、アプリケーション単位およびグローバルな K8s アップストリームによって責任範囲を明確に分離します。同時に、Edge Admin はクラスター内の Service/Endpoints を監視(watch)し、バックエンドインスタンスの変更をアップストリームに同期させることが可能です。——このサービスディスカバリ機能と、ゲートウェイノードの自動管理機能は互いに独立しており、要件に応じて個別にも、組み合わせて利用することもできます。

機能 1:真の弾力性を実現――ゲートウェイノードのライフサイクル管理の自動化

従来ソリューションの限界: 従来のゲートウェイにおけるノード管理プロセス(新規ノードの起動 → 参加リクエスト → 管理者による承認 → クラスタへ参加)は、K8s 環境では現実的ではありません。このプロセスは、K8s が持つ本来の弾力性を、人手による承認という効率のボトルネックに縛り付けてしまいます。これは単なる運用上の負担であるだけでなく、K8s への投資対効果(ROI)を直接的に損なう要因となります——企業は弾力性のためにコストを支払っているにもかかわらず、ゲートウェイにおける人手作業のボトルネックによって、その価値を完全には享受できていないのです。

OpenResty Edge のソリューション:K8s クラスタ連携による、「ゼロタッチ」な自己修復とスケーリング

OpenResty Edge の管理画面(Admin)でゲートウェイクラスターを一つまたは複数の K8s クラスタと連携させることで、信頼関係を事前に確立します。これにより、信頼関係が確立された K8s クラスタに OpenResty Edge Node がデプロイされると、管理画面(Admin)は参加待機中のノードを定期的に自動検出し、承認します。人手による操作は一切不要で、ノードは対応するゲートウェイクラスターへ自動的に追加されます。

┌─────────────────────────────────────────────────────----┐

│ K8s クラスター(信頼関係を確立済み) │

│ │

│ Pod の起動/再起動/スケールアウト ──> 自動登録 ──> 自動承認 ──> ゲートウェイクラスターへ参加 │

│ │

└────────────────────────────────────────────────────----─┘

- 故障の自己修復を「分単位」から「秒単位」へ:K8s が異常な Pod を再起動すると、新しいインスタンスが即座にトラフィック処理を引き継ぎます。全プロセスに人手は介在せず、平均修復時間(MTTR)は、エンジニアの対応を待つ必要があった従来の分単位から、システムが自動で完了させる秒単位へと劇的に短縮されます。

- 弾力性への投資効果を最大化:HPA(Horizontal Pod Autoscaler)によってスケールアウトしたゲートウェイインスタンスが、即座にトラフィックを処理できるようになります。これにより、突発的なトラフィック急増への対応が完全に自動化され、K8s の弾力性に対する投資効果を最大限に引き出すことができます。

- 運用コストの削減:運用チームを「承認ロボット」のような単純な繰り返し作業から解放し、より付加価値の高い業務に集中させることが可能になります。

機能 2:サイロ化から一元管理へ — マルチ K8s クラスタの戦略的価値

従来のアプローチの限界: マルチクラスター環境において、最も直接的なアプローチは、クラスターごとに独立したゲートウェイ管理システムを導入することです。この方法は一見シンプルですが、実際には「設定ドリフト」という問題の温床となります。各クラスターのルーティング、タイムアウト、セキュリティポリシーが日々の更新作業の中で徐々に乖離していき、ある障害調査の際に初めて「設定は同じはずなのに、なぜ挙動が違うのか?」という問題に直面するのです。さらに重要なのは、このようなサイロ化された管理では、クラスター間のトラフィックスケジューリングや、マルチアクティブ・ディザスタリカバリといった戦略レベルの機能が、アーキテクチャ図上の構想にとどまり、実現不可能になってしまう点です。

OpenResty Edge のソリューション:統合管理プレーンとクラスター横断型アップストリーム集約。

K8s クラスターの接続情報は Admin コンソールで一元的に登録・管理されます。設定項目には、クラスター名、API アドレス、ポート、SSL 検証オプション、トークンなどが含まれ、きめ細やかなタイムアウト制御(接続/読み取り/送信)をサポートします。

その上で、マルチクラスターの真価を解き放つのが、クラスター横断型アップストリーム集約機能です。単一のアップストリームに、異なる K8s クラスターのサービスインスタンスを同時に含めることができます。これにより、ゲートウェイ層はクラスターを横断したグローバルな視野を獲得し、複数クラスターのサービスヘルスステータスを感知した上で、トラフィックの割り当てとスケジューリングを一元的に行うことが可能になります。

- 戦略レベルの高可用性アーキテクチャを実現:クラスター横断型アップストリーム集約機能は、マルチアクティブデータセンター、地理的ディザスタリカバリ、スムーズなクラウド移行といったアーキテクチャを「計画」から「現実」のものとする、鍵となるインフラストラクチャです。プライマリークラスターに障害が発生した場合や、メンテナンスが必要な際には、ゲートウェイが自動的かつスムーズにトラフィックをスタンバイクラスターに切り替えます。

- 設定ドリフトの根本原因を解消:統合管理プレーンは、複数のクラスター群が単一の設定ソースを共有することを意味します。これにより、「設定は同じはずなのに、挙動が異なる」といった、原因究明が困難な潜在的障害をアーキテクチャレベルで根本から解消します。

機能 3:組織構造との適合——2層アップストリームシステムの設計思想

組織規模の拡大がもたらす新たな課題: K8s プラットフォームが、単一チーム向けのサービスから、複数事業部門が共有するインフラストラクチャへと進化する過程で、設定管理においては組織の壁に起因する典型的な問題に直面します。プラットフォームチームが管理する共有サービス(認証、ログなど)と、事業部門が管理するバックエンドサービスが、同一の設定システム内に混在し、権限と責任の所在が曖昧になるのです。一見無害に思える「設定の整理」作業が、意図せず他チームのサービス停止を招いてしまう可能性があります。こうした事故の根源は、エンジニアの過失にあるのではなく、システム設計そのものに、ヒューマンエラーを許容してしまう脆弱性があったかどうかにあります。

OpenResty Edge のアプローチ:アプリケーションレベルとグローバルレベルのアップストリームで、チームの権責範囲をマッピング。

OpenResty Edge は、大規模組織のアップストリームサービスが本来持つ階層構造に着目し、「2 層アップストリーム」システムを設計することで、技術アーキテクチャと組織構造を一致させます。

| 観点 | アプリケーションレベル K8s アップストリーム | グローバル K8s アップストリーム |

|---|---|---|

| 管理主体 | 事業部門チーム | プラットフォーム/インフラチーム |

| スコープ | 特定のアプリケーション/ドメインに紐づく | アプリケーションを横断して全体で共有 |

| 適用シナリオ | 各事業アプリケーション専用のバックエンドサービス | プラットフォームレベルの共通サービス |

- チーム間の連携における摩擦を低減:権責範囲を明確に分離することで、プラットフォームチームと事業部門チームは、相互に影響を与えることなく、それぞれが管轄する設定を安全かつ独立して管理できます。

- プラットフォームの安定性を向上:アーキテクチャレベルの設計によって、複数チームの共同作業に起因する設定の上書きや誤削除といった事故を根本的に防止し、共有プラットフォームの堅牢性を高めます。

- 組織構造を反映したアーキテクチャ:優れたプラットフォームツールとは、その設計が組織のコラボレーションモデルを的確に反映し、それをシンプルにするものでなければなりません。2層アップストリームシステムは、まさにこの思想を具現化したものです。

まとめ

K8s 向けゲートウェイを評価する際には、「クラスター内にデプロイ可能か」という点に加え、さらに問うべき3つのポイントがあります。それは、動的な環境下で依然として手動によるノード承認が必要か。複数のクラスターを単一のコントロールプレーンで管理し、期待どおりのルーティングとアップストリーム構成を維持できるか。そして、複数チームで共用する際に、誤変更の影響範囲を限定するための明確な権限スコープが備わっているか、という点です。

OpenResty Edge は、これらの課題に対して以下のアプローチで対応します。クラスターの紐付けと自動承認機能により、ノードのライフサイクル管理とスケーラビリティを統合します。集中登録とクラスター横断でのアップストリーム集約により、検証可能なグローバル設定に基づいたマルチクラスターのトラフィック管理を実現します。そして、アプリケーションレベルおよびグローバルな K8s アップストリーム設定を通じて、組織の役割分担をコンフィグレーションモデルに反映させます。これらの機能に加えて、Service/Endpoints ベースのアップストリーム検出機能も提供しており、業務要件に応じて単独で、あるいは組み合わせて利用することが可能です。

管理コンソール(Admin)の画面と照らし合わせながら結合テストを実施する場合は、以下の2つのチュートリアルをご参照ください。OpenResty Edge で Kubernetes(K8s)アップストリームへのトラフィックを管理する(K8s のグローバル登録、読み取り専用権限を持つ Service Account Token の Admin への設定、Kubernetes アップストリームの作成とページルールでの参照、Endpoint の変更が転送先に反映されるかの確認);OpenResty Edge で Kubernetes 環境におけるゲートウェイサーバーの自動管理を実現する方法(ゲートウェイクラスターへの対象 K8s の紐付け、自動承認の有効化、マニフェストファイルによるゲートウェイノードの起動、Pod 交換後に新しいインスタンスが手動操作なしでクラスターに参加できるかの検証)。本稿では、課題と機能の対応範囲を概説するにとどめ、具体的な操作手順やコマンドについては、上記 2 つのチュートリアルに準じます。

OpenResty Edge について

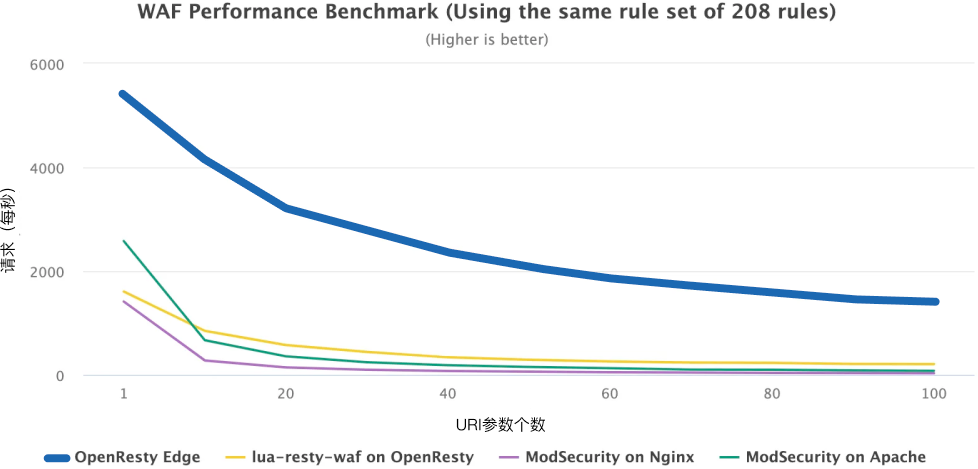

OpenResty Edge は、マイクロサービスと分散トラフィックアーキテクチャ向けに設計された多機能ゲートウェイソフトウェアで、当社が独自に開発しました。トラフィック管理、プライベート CDN 構築、API ゲートウェイ、セキュリティ保護などの機能を統合し、現代のアプリケーションの構築、管理、保護を容易にします。OpenResty Edge は業界をリードする性能と拡張性を持ち、高並発・高負荷シナリオの厳しい要求を満たすことができます。K8s などのコンテナアプリケーション トラフィックのスケジューリングをサポートし、大量のドメイン名を管理できるため、大規模ウェブサイトや複雑なアプリケーションのニーズを容易に満たすことができます。

著者について

章亦春(Zhang Yichun)は、オープンソースの OpenResty® プロジェクトの創始者であり、OpenResty Inc. の CEO および創業者です。

章亦春(GitHub ID: agentzh)は中国江蘇省生まれで、現在は米国ベイエリアに在住しております。彼は中国における初期のオープンソース技術と文化の提唱者およびリーダーの一人であり、Cloudflare、Yahoo!、Alibaba など、国際的に有名なハイテク企業に勤務した経験があります。「エッジコンピューティング」、「動的トレーシング」、「機械プログラミング」 の先駆者であり、22 年以上のプログラミング経験と 16 年以上のオープンソース経験を持っております。世界中で 4000 万以上のドメイン名を持つユーザーを抱えるオープンソースプロジェクトのリーダーとして、彼は OpenResty® オープンソースプロジェクトをベースに、米国シリコンバレーの中心部にハイテク企業 OpenResty Inc. を設立いたしました。同社の主力製品である OpenResty XRay動的トレーシング技術を利用した非侵襲的な障害分析および排除ツール)と OpenResty Edge(マイクロサービスおよび分散トラフィックに最適化された多機能

翻訳

英文版の原文と日本語訳版(本文)をご用意しております。読者の皆様による他の言語への翻訳版も歓迎いたします。全文翻訳で省略がなければ、採用を検討させていただきます。心より感謝申し上げます!